Cool Timeline

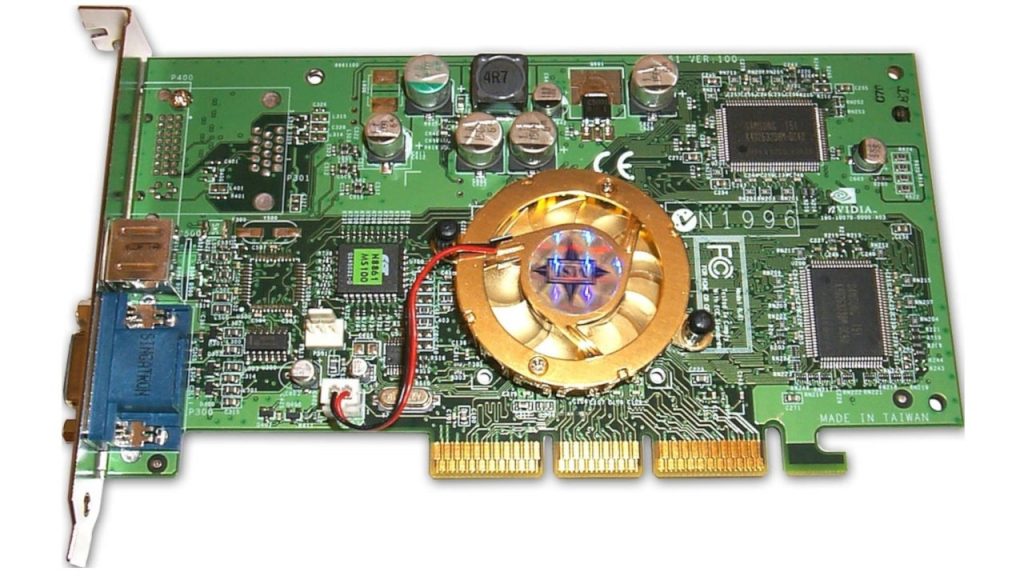

Die Riva 128 stellt als eine der ersten Grafikkarten sowohl 2D als auch 3D dar, wobei sie insbesondere bei der 2D-Darstellung punktet. In Sachen 3D liefert der mit 4 MByte Videospeicher bestückte Riva-Chip ebenfalls gute Messwerte. Unterm Strich kann Nvidia mit der Riva 128 erstmals im Grafikmarkt Fuß fassen.

Die Riva TNT (für »TwiNTexel«) erscheint im Oktober 1998 und ist der technisch fortschrittlichste Vertreter aller damals erhältlichen Grafikchips. Von 32-Bit-Rendering über zwei Textureinheiten bis hin zur Unterstützung von Bump Mapping, anisotroper Filterung und Antialiasing ist alles an Bord. In der Kombination aus Geschwindigkeit und Bildqualität kann sich die Riva TNT mit knappem Vorsprung gegen die Voodoo 2 behaupten.

Nach der Riva TNT und TNT2 präsentiert Nvidia mit der Geforce 256 die erste DirectX-7-fähige Grafikkarte und führt die Geforce-Bezeichnung für Grafikkarten ein. Durch die T&L-Einheit (Transform & Lightning) und die doppelte Anzahl an Rendering-Pipelines ist die Geforce 256 der Konkurrenz von 3dfx und ATI überlegen, auch wenn der Geometriebeschleuniger anfangs nur in einigen OpenGL-Titeln wie Quake 3 sein Potenzial ausspielen kann.

Wie schon von den TNT-Serien bekannt, unterscheiden sich die Grafikchips der Geforce-2-Serie hauptsächlich durch deutlich höhere Taktraten vom Vorgänger Geforce 256. Den Auftakt macht die Geforce 2 GTS (für »Giga-Texel-Shader«), die erstmals eine Füllrate von mehr als einer Milliarde Texel pro Sekunde erreicht. Die im Anschluss folgende Geforce-2-MX-Serie ist durch ihr herausragendes Preis-Leistungs-Verhältnis bei Spielern besonders beliebt. Als erste Nvidia-Grafikkarte beherrscht sie zudem den Umgang mit zwei Monitoren.

Drei Monate nach der Übernahme von 3dfx erscheint Nvidias Geforce-3-Serie. Zusammen mit Microsofts Schnittstelle DirectX 8 beginnt damit das Zeitalter der programmierbaren Grafikchips. Die Pixel- und Vertex-Shader sind im Vergleich zu heutigen Grafikchips aber noch relativ unflexibel. Gegenüber der Geforce 2 wird die Kantenglättung beschleunigt und der anisotrope Texturfilter verbessert. Nach der Veröffentlichung der Geforce 3 im Februar 2001 folgen mit den Modellen Geforce 3 Ti 200 und Geforce 3 Ti 500 jeweils ein langsameres beziehungsweise schnelleres Modell, die sich hauptsächlich nur beim Chiptakt und beim Videospeicher (bis zu 128 MByte) unterscheiden.

Die Geforce 4 basiert im Wesentlichen auf der Geforce 3, arbeitet aber um einiges schneller und besitzt wie die Geforce-2-Serie große Chip- und Modellvielfalt. Vor allem die Geforce 4 4200 Ti bietet zu ihrer Zeit ein nahezu unschlagbares Preis-Leistungs-Verhältnis und ist bei Spielern deshalb äußerst beliebt. Bei der preisgünstigen Geforce-4-MX-Serie streicht Nvidia jedoch die DirectX-8-Unterstützung. Deshalb warnt sogar der damalige CEO von id Software John Carmack die Spieler im Zusammenhang mit Doom 3 vor einem Kauf!

Nachdem Konkurrent ATI die überraschend starke Radeon-9000-Serie veröffentlicht hat, enthüllt Nvidia einige Monate darauf die Geforce-FX-Generation und steigt ebenfalls in die DirectX-9-Ära ein, wenn auch nicht auf ATIs Niveau. Neben dem Topmodell Geforce FX 5800 Ultra bietet Nvidia die bislang größte Modellvielfalt der Unternehmensgeschichte an. Geforce-FX-Grafikkarten decken direkt zum Marktstart im März 2003 Einsteiger, Mittelklasse und High-End ab. Doch insbesondere die schnellen Modelle kranken an konzeptionellen Mängeln, verbrauchen zu viel Strom und machen einen Höllenlärm – weshalb sie oft als Fön bezeichnet werden. Spätere Modelle wie die FX 5900 Ultra holen gegenüber der Radeon-Konkurrenz trotzdem auf und die ersten PCI-Express-Varianten folgen.

Mit der Geforce 6 streicht Nvidia das erst beim Vorgänger eingeführte FX-Kürzel – vermutlich auch, um den mäßigen Erfolg und das schlechte Image durch den lauten Lüfter zu begraben. Die neue Generation erklimmt im Wettstreit mit ATI jedenfalls wieder die Technologieführerschaft. Die erweiterten Shader-Fähigkeiten von DirectX 9.0c geben den Spiele-Entwicklern bisher nie gekannte Freiheiten an die Hand. Zu den mit DirectX 9.0c eingeführten Neuerungen gehören unter anderem HDR-Beleuchtung (gemeint ist ein relativ simpler Grafikeffekt in Spielen, nicht das heutige HDR, das auch einen passenden Monitore beziehungsweise Fernseher voraussetzt) und eine bessere Programmierbarkeit.

Die Geforce 7 ist eine erheblich beschleunigte Geforce 6 und lange Zeit ganz oben in den Benchmark-Tabellen zu finden. Mit den Topmodellen wie der Geforce 7900 GTX läuft Far Cry erstmals mit HDR-Beleuchtung (halbwegs) flüssig. Die Geforce 7 ist die letzte Grafikkarten-Serie von Nvidia, die den alternden und zu dieser Zeit allmählich verdrängten AGP-Steckplatz noch unterstützt. Zukünftige Serien setzen voll und ganz auf die modernere Schnittstelle PCI Express.

Nvidia betritt mit der Geforce 8 erstmals die DirectX-10-Bühne. Nachdem die Geforce-7-Serie technologisch noch größtenteils dem Vorgänger entsprochen hat, handelt es sich hierbei wieder um eine in vielen Punkten komplett neu erstellte Grafikkarten-Generation. Käufer des im November veröffentlichten Topmodells Geforce 8800 GTX spielen fast zwei Jahre lang jedes Spiel ohne Detaileinschränkungen. Die ersten DirectX-10-Spiele sehen dabei jedoch nicht besser aus als unter DirectX 9, sie laufen nur langsamer. Fast ein Jahr nach der Veröffentlichung erscheint mit der Mittelklassevariante Geforce 8800 GT eine der erfolgreichsten Nvidia-Grafikkarten überhaupt.

Bei der Geforce-9-Generation steigert Nvidia gegenüber dem Vorgänger ordentlich die Taktfrequenzen. Dennoch hat die Namensgebung auch Schattenseiten: Einige Modelle wie die sehr beliebte Geforce 8800 GT werden einfach nur umgetauft, dann als Geforce 9800 GT verkauft und dienen damit als Lückenfüller bis zur Vorstellung der ersten Geforce-200-Grafikkarten.

Noch im gleichen Jahr geht es mit der Geforce-200-Serie weiter. Im Sommer 2008 stellt Nvidia über anderthalb Jahre nach der Geforce 8 eine wirklich neue Grafikkarten-Generation für Spieler vor. In die neuen Grafikchips sind einige Veränderungen eingeflossen, um die Spieleleistung stark zu erhöhen. Anders als AMD bei der Radeon HD-4800-Serie verzichtet Nvidia jedoch auf DirectX 10.1, das wohl auch deshalb von Spieleentwicklern bis auf wenige Ausnahmen vernachlässigt wird.

Nach mehrfacher Verspätung und über ein halbes Jahr nach AMD bringt Nvidia Ende März 2010 seine ersten DirectX-11-fähigen Grafikkarten auf den Markt. Die Geforce GTX 480 bietet zwar eine extrem hohe Leistung, frisst aber sehr viel Strom, wird noch dazu äußerst heiß und hat einen unerträglich lauten Lüfter. Vergleiche zur Geforce FX 5800 Ultra aus dem Jahr 2003 bleiben nicht aus. Erst die Mittelklasse-Karte Geforce GTX 460 kombiniert die Technik der GTX 480 mit einem leisen Lüfter und wird so zu Nvidias erfolgreichster Grafikkarte seit der Geforce 8800 GT.

Nur ein halbes Jahr nach der Vorstellung der 400er-Serie mit dem Topmodell Geforce GTX 480 bringt Nvidia mit der optimierten 500er-Serie die Geforce GTX 580 auf den Markt. Gegenüber dem Vorgänger steigt die Leistung der zweiten Generation von DirectX-11-Grafikkarten um rund 20 Prozent an. Auch beim Kühldesign gibt es einen hörbaren Unterschied: Der Lüfter der GTX 580 ist nun deutlich leiser unter Last.

Seine erste DirectX-11.1-Grafikkarte bringt Nvidia etwas später als AMD auf den Markt. Die Geforce GTX 680 basiert auf der bewährten Technik von GTX 400 und GTX 500 auf, verbraucht durch den neuen 28-nm-Fertigungsprozess aber weniger Strom bei gleichzeitig höherer Leistung. Als erste Grafikkarte überhaupt verfügt die neue Geforce über einen Turbo-Modus, der die Taktfrequenz in Abhängigkeit zu Temperatur und Stromverbrauch dynamisch steigert. Zudem unterstützt Nvidia jetzt den Anschluss von mehr als zwei Monitoren an einer Grafikkarte.

Die GTX 700-Serie basiert größtenteils auf dem GK104-Chip, der schon in der vorherigen Generation zum Einsatz gekommen ist. Erst ab der Geforce GTX 780 verbaut Nvidia den deutlich leistungsfähigeren GK110-Chip. Die neuen Karten verfügen über etwa 15 bis 20 Prozent mehr Leistung und übernehmen den grundsoliden Kühler, der mit der GTX Titan eingeführt wurde. Als Antwort auf die Radeon R9 290X von AMD veröffentlicht Nvidia im November die Geforce GTX 780 Ti. Um den Konkurrenten zu schlagen, verbaut Nvidia einen GK110 im Vollausbau, was brachiale Performance in Spielen zur Folge hatte.

Die Maxwell-Architektur richtet sich in Form der Geforce-GTX-900-Serie an Spieler und Enthusiasten. Neben der gestiegenen Leistung verbessert sich vor allem die Energieeffizienz und auch das Taktpotenzial fällt generell sehr hoch aus. Zum Launch schlägt die Geforce GTX 980 das bisherige Kepler-Topmodell Geforce GTX 780 Ti mühelos und erreicht sogar in UHD-Auflösung gelegentlich flüssige Bildraten. Noch stärker als die 3D-Leistung beeindruckt aber der deutlich gesunkene Stromverbrauch. Denn obwohl Nvidia bei Maxwell weiterhin auf Chips mit 28 nm Strukturbreite setzt, steigt die Energieeffizienz an, was auch eine leisere Kühlung ermöglicht.

Nach vier Jahren hat die Fertigung in 28 Nanometern endgültig ausgedient. Für die Geforce-GTX-1000-Serie wechselt Nvidia auf eine feinere Strukturbreite von 16 Nanometern. Die Pascal-Mikroarchitektur ist zwar keine grundlegende Neuerfindung, stellt aber eine an den richtigen Stellen optimierte Version des Maxwell-Vorgängers dar. So schlägt zum Beispiel das Topmodell Geforce GTX 1080 zur Veröffentlichung den Vorgänger GTX 980 um rund 60 Prozent in Spielen und das bei nahezu identischer Leistungsaufnahme. Auch die GTX 980 Ti wird von der GTX 1080 deutlich überholt. Möglich machen das stark angezogene Taktraten von bis zu 1.800 MHz unter Last. Apropos angezogen: Auch die Preise fallen der Leistung entsprechend hoch aus. Nvidia sieht einen Startpreis von 790 Euro vor.

Mit der Geforce-RTX-2000-Serie legt Nvidia den Fokus auf Raytracing, daher auch der Namenswechsel von GTX zu RTX. Um die realistische Berechnung von Licht, Schatten und Reflektionen zu stemmen, verfügen die Turing-Grafikkarten über eigene Kerne, die sich ausschließlich Raytracing-Aufgaben widmen. Die neue Spieler-Architektur besitzt zudem auch die von professionellen Volta-Grafikkarten bekannten Tensor-Kerne, die sich um KI-Berechnungen sowie den neuen Kantenglättungsmodus DLSS kümmern. Auch abseits der neuen Features können sich die Grafikkarten teils mit einer ordentlichen Leistungssteigerung zum direkten Vorgänger hervorheben.

Lange Zeit war die RTX-3000-Serie kaum zu vernünftigen Preisen erhältlich. Schuld war die weltweite Chip-Krise, die für mangelnden Nachschub und dadurch immer größere Mondpreise gesorgt hat. Dabei sind die Karten echte technische Leckerbissen. Eine nochmals gesteigerte Raytracing-Leistung, rasend schneller GDDR6x-Speicher, zusätzliche Shader-Einheiten – in Sachen Spieleperformance thront das Flaggschiff in Form der RTX 3090 Ti an der Spitze. Das hat aber auch seinen Preis, und zwar gleich in doppelter Hinsicht. Neben einem nach wie vor hohen Einkaufspreis saugen die Karten noch dazu viel Strom. Vor allem letzteres könnte sich laut aktueller Gerüchte mit der RTX-4000-Serie noch verstärken, aber nur die Zukunft wird es zeigen!